“여보세요?” 한마디 했더니 ‘뚝’…AI가 내 목소리 훔쳐간다

김유민 기자

수정 2026-05-09 15:59

입력 2026-05-09 15:59

세줄 요약

- 모르는 번호의 침묵 전화, 음성 수집 의심

- 짧은 음성만으로 딥보이스 복제 가능성 확대

- 가족 사칭 보이스피싱, 재확인 필요 강조

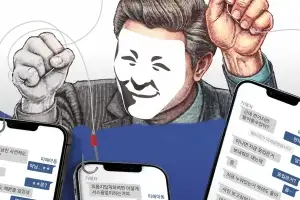

모르는 번호로 전화가 왔을 때 무심코 “여보세요?”라고 먼저 말했다가 AI 음성 복제 범죄에 악용될 수 있다는 경고가 나왔다.

짧은 음성만으로도 목소리와 억양, 말투를 복제하는 ‘딥보이스’ 기술이 빠르게 발전하면서 단 몇 초 분량의 음성 샘플도 보이스피싱 범죄에 활용될 수 있다는 것이다.

6일(현지시간) 프랑스 정보통신 전문 매체 GNT는 최근 이른바 ‘침묵 전화’ 수법이 AI 음성 복제를 위한 사전 작업일 가능성이 있다고 보도했다.

이 수법은 전화가 걸려온 뒤 수신자가 “여보세요”라고 먼저 말하면 상대가 아무 말 없이 끊어버리는 방식이다. 단순 오접속이나 통신 오류처럼 보이지만 실제로는 음성 수집과 번호 활성 여부 확인을 위한 과정일 수 있다는 설명이다.

사기범들은 우선 해당 번호가 실제 사용 중인지 확인한 뒤 이를 피싱 범죄 표적 목록에 올리거나 다크웹 등에서 거래하는 것으로 전해졌다.

더 큰 문제는 AI 음성 복제 기술이다. 사이버보안업체는 “목소리와 억양, 음색을 복제하는 것은 사람들이 생각하는 것보다 훨씬 쉽다”고 경고했다.

실제 최근 AI 기술은 2~5초 정도의 짧은 음성만으로도 특정인의 말투를 흉내 낼 수 있는 수준까지 발전했다.

정수환 교수는 지난해 CBS ‘김현정의 뉴스쇼’에 출연해 “최근에는 2초 음성 샘플만 있어도 어느 정도 품질이 나온다”며 “목소리만 들어서는 합성 여부를 구분하기 어려운 단계에 와 있다”고 설명했다.

복제된 목소리는 가족이나 지인에게 연락해 “급히 돈이 필요하다” “사고가 났다” 같은 긴급 상황을 꾸며내는 보이스피싱 범죄에 악용될 수 있다.

실제 국내 피해 규모도 빠르게 커지고 있다. 이동통신업계에 따르면 올해 1~5월 보이스피싱 피해액은 총 2564억원으로 지난해 같은 기간(1713억원)보다 약 50% 증가했다.

전문가들은 모르는 번호로 걸려온 전화에서 상대방이 아무 말도 하지 않을 경우 즉시 전화를 끊고, 불필요하게 이름이나 목소리를 먼저 노출하지 않는 게 좋다고 조언한다.

특히 가족이나 지인을 사칭해 돈을 요구하는 전화가 올 경우 반드시 직접 다시 전화하거나 문자·영상통화 등으로 본인 여부를 재확인해야 피해를 줄일 수 있다고 강조했다.

김유민 기자

Copyright ⓒ 서울신문 All rights reserved. 무단 전재-재배포, AI 학습 및 활용 금지

Q.

기사를 다 읽으셨나요? AI 퀴즈로 핵심 점검!

AI 음성 복제가 가능한 최소 음성 샘플 길이는?